Panduan Disaster Recovery: Terbukti Hentikan Hemoragi Data

Lampu indikator peladen Anda menyala hijau. Hasil ping jaringan menunjukkan respons di bawah 2 milidetik. Tim operasional sudah bersiap pulang karena merasa arsitektur berjalan mulus. Tapi di balik layar, aplikasi web portal B2B Anda diam-diam menyajikan tabel kosong kepada klien korporat. Sinkronisasi kerangka basis data terputus di latar belakang. Transaksi bernilai ratusan juta rupiah masuk ke dalam antrean (queue), membeku, lalu terhapus otomatis oleh sistem pembersihan memori sementara. Inilah yang kita sebut sebagai hemoragi data. Pendarahan digital fatal yang tidak memicu alarm satu pun, tapi sanggup membangkrutkan perusahaan Anda dalam semalam.

Banyak praktisi IT terjebak dalam delusi bahwa server yang menyala adalah server yang sehat. Mereka menyusun dokumen tebal penuh jargon pelacakan aset, namun buta terhadap konsistensi data di level granular. Membangun sekadar cadangan (backup) rutin setiap tengah malam sudah bukan lagi solusi. Itu hanyalah obat penenang palsu. Jika arsitektur pemulihan Anda tidak dirancang untuk menghentikan pendarahan log transaksi secara seketika saat anomali I/O (Input/Output) terjadi, Anda sedang menunggangi bom waktu.

Standar Kepatuhan Terminasi Hemoragi Data

Hentikan perdebatan opini internal. Saat berhadapan dengan aset digital berskala enterprise, kita tunduk pada kerangka kerja mitigasi krisis dari lembaga standarisasi global.

Panduan Disaster Recovery (DR) menurut kerangka NIST SP 800-34 Rev. 1 tentang Perencanaan Kontingensi adalah eksekusi terstruktur untuk memulihkan operasi kritis dan mencegah degradasi integritas informasi. Untuk menghentikan hemoragi data secara absolut, arsitektur DR wajib memvalidasi mekanisme berikut:

- Penahanan otomatis pada log Write-Ahead (WAL) saat latensi replikasi tinggi.

- Eksekusi isolasi basis data (fencing) untuk mencegah sindrom Split-Brain.

- Ketersediaan penyimpanan objek luring (air-gapped) dengan kuncian tak terubahkan.

Ketetapan teknis tersebut menyapu bersih metode tradisional. Jika Anda masih menggunakan skrip penyalinan berkas manual via FTP, Anda pada dasarnya melanggar standar kepatuhan operasional paling mendasar.

Anatomi Pendarahan Data di Urat Nadi Basis Data

Hemoragi data paling brutal jarang bermula dari serangan peretas luar. Ia bermula dari miskonfigurasi arsitektur internal Anda sendiri. Mari kita bedah kasus replikasi asinkron yang sering dipuja-puja demi kecepatan.

Anda mengatur peladen PostgreSQL utama di Jakarta dan peladen replikasi sekunder di Singapura. Agar aplikasi tidak lambat, Anda menggunakan replikasi asinkron. Transaksi masuk, ditulis ke peladen utama, aplikasi langsung memberikan respons “Sukses” ke klien, baru sepersekian detik kemudian data dikirim ke Singapura. Cepat. Efisien. Mematikan.

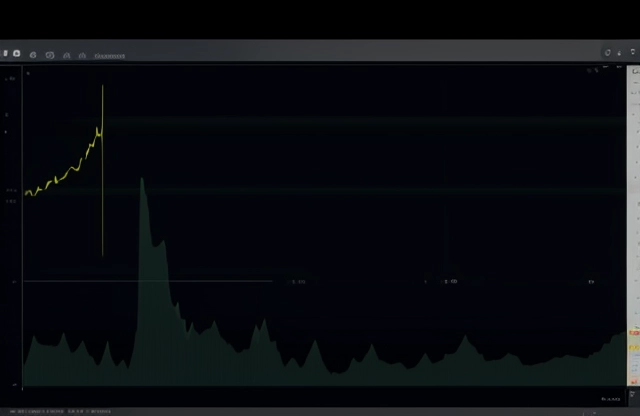

Suatu hari, ada kampanye promo masif. Antrean Write-Ahead Logging (WAL) di peladen utama menumpuk. Peladen Singapura tertinggal (lagging) sejauh 5 menit. Tepat pada momen ini, motherboard peladen utama di Jakarta terbakar. Skrip failover otomatis Anda berjalan sempurna, memindahkan rute DNS ke peladen Singapura. Aplikasi web menyala kembali. Klien bisa login. Namun, data transaksi selama 5 menit terakhir menguap ke udara. Pendarahan data terjadi, dan karena skrip failover berjalan terlalu “mulus”, tidak ada yang sadar bahwa pangkalan data di Singapura itu cacat permanen. Ini adalah harga mahal dari kebodohan mengabaikan batas toleransi metrik Recovery Point Objective (RPO).

Sistem antrean pesan seperti RabbitMQ atau Kafka juga sering menjadi lokasi tempat darah mengucur deras. Anda bisa mempelajari resolusi kemacetan antrean RabbitMQ pada integrasi ERP logistik untuk melihat bagaimana tumpukan pesan tak terkirim bisa merusak harmoni data antar layanan mikro (microservices). Jika message broker Anda tidak memiliki ketahanan persisten saat peladen dimatikan paksa, seluruh instruksi eksekusi akan lenyap tanpa jejak audit.

Matriks Validasi Arsitektur Anti-Hemoragi

Untuk memetakan titik lemah infrastruktur, saya biasanya membongkar skema klien korporat menggunakan matriks perbandingan visibilitas data berikut. Ini bukan sekadar teori, melainkan realitas konfigurasi di tingkat mesin.

| Topologi Basis Data | Mekanisme Sinkronisasi | Risiko Hemoragi Data (Pendarahan) | Mitigasi Teknis Ekstrem |

|---|---|---|---|

| Single Node (Monolitik) | Cron Job Backup (Dump SQL harian) | Kehancuran Total. Kehilangan data hingga 24 jam jika disk korup di sore hari. | Gunakan Continuous Archiving (Streaming WAL) ke Object Storage terpisah. |

| Master – Slave (Asynchronous) | Replikasi Log Tertunda | Moderat ke Tinggi. Data menguap sebesar jarak latensi lag saat Master mati mendadak. | Terapkan Query Throttling di sisi aplikasi jika latensi Slave melebihi toleransi RPO. |

| Master – Master (Synchronous) | Commit dua arah wajib (Quorum) | Sangat Rendah. Tidak ada data hilang, namun aplikasi akan terhenti (hang) jika jaringan antar node putus. | Implementasikan algoritma Paxos/Raft dengan node Arbiter ketiga untuk mencegah Split-Brain. |

| Distributed SQL (Geo-Partitioned) | Konsensus Multi-Region Bawaan | Mendekati Nol. Tahan terhadap kegagalan seluruh zona ketersediaan penyedia cloud. | Pengawasan latensi BGP Routing yang ketat agar kuorum tidak pecah akibat anomali internet global. |

Chaos Engineering: Menginjeksi Racun ke Arsitektur Sendiri

Rencana penanganan bencana Anda hanyalah sebuah novel fiksi ilmiah jika Anda tidak pernah benar-benar mencabut kabel power server Anda di jam sibuk. Lingkungan staging tidak memiliki tekanan. Tidak ada trafik bot, tidak ada tabel raksasa bernilai jutaan baris, dan tidak ada memori cache yang bocor. Anda wajib membakar sistem di lingkungan produksi (production).

1. Isolasi Node Pemimpin secara Paksa (Fencing Test)

Bencana terburuk dalam topologi ketersediaan tinggi (High Availability) bernama Sindrom Split-Brain. Ini terjadi ketika peladen utama (Master) dan cadangan (Slave) kehilangan kontak jaringan satu sama lain, padahal keduanya masih menyala sehat.

Peladen cadangan mengira peladen utama telah tewas. Ia lalu mengangkat dirinya menjadi pemimpin baru. Kini Anda memiliki dua otak yang menerima transaksi pembayaran secara terpisah. Begitu kabel jaringan tersambung kembali, data dari kedua mesin ini saling bertabrakan (collision). Untuk mengujinya, konfigurasikan aturan firewall (iptables) dadakan yang memblokir IP peladen Master secara spesifik. Jika kluster Anda tidak memiliki sistem STONITH (Shoot The Other Node In The Head) yang secara brutal mematikan peladen Master lama via antarmuka manajemen daya perangkat keras, maka arsitektur Disaster Recovery Anda gagal total.

2. Validasi Kunci Kekekalan Cadangan (Immutable Storage)

Menyimpan basis data Anda di dalam peladen yang sama adalah kebodohan. Menyimpannya di peladen berbeda tetapi dengan kata sandi akses jaringan yang sama persis adalah bunuh diri. Ransomware modern sangat cerdas. Begitu mereka membobol peladen utama Anda, skrip mereka akan mencari file konfigurasi cadangan, mengakses peladen cadangan Anda, dan mengenkripsi file backup tersebut juga.

Audit yang sahih mengharuskan Anda menggunakan penyimpanan objek kelas AWS S3 atau layanan setara yang memiliki fitur Object Lock Compliance Mode. Jalankan simulasi masuk sebagai Administrator Penuh (Root), lalu coba eksekusi perintah hapus paksa pada direktori cadangan tersebut. Jika berkas berhasil terhapus, Anda gagal. Berkas tersebut harus mustahil dihapus oleh siapa pun, bahkan oleh vendor cloud itu sendiri, sampai batas waktu retensi (misal 30 hari) berakhir.

Sisi Gelap dan Tantangan Keseimbangan Operasional

Saya tidak akan membohongi Anda dengan narasi utopia teknologi. Membangun perlindungan dari hemoragi data ini sangat menguras kas perusahaan. Terdapat anomali biaya lisensi ganda yang menjebak. Vendor basis data komersial sering menagih lisensi CPU secara penuh pada peladen cadangan pasif Anda yang sebenarnya hanya duduk manis menunggu bencana datang. Ini membengkakkan Rencana Anggaran Biaya (RAB) infrastruktur TI secara eksponensial.

Selain itu, terdapat kutukan latensi fisika. Semakin sempurna Anda ingin memastikan konsistensi data sinkron antara dua kota yang berbeda, semakin lambat aplikasi web Anda merespons klik dari pengguna akhir. Cahaya membutuhkan waktu melintasi kabel serat optik. Memaksakan Zero Data Loss pada aplikasi manajemen cuti internal yang hanya dipakai 50 karyawan adalah kesesatan desain. Tingkat toleransi pendarahan data harus diselaraskan secara matematis dengan kerugian finansial yang sebenarnya (Cost of Downtime).

[IMG_3]

Praktek di lapangan emang kadang ngaco banget sih di luar ekspektasi. Gua pernah ngerasain sendiri pas lagi setup server AI lokal di rumah buat ngerunning automation script. Gue pake framework CI4 local buat ngatur antrean (queue) generate teks sama image biar jalan masal pas gua tidur. Desain database SQLite-nya sengaja gua bikin asinkron biar kenceng nulis ke disk. Logikanya kan gampang, sekali klik jalan tuh semua jadwal random. Eh taunya jam 3 pagi meteran listrik jeglek.

UPS emang nyala, tpi cuma kuat semenit dan skrip failover otomatis gua ngga sempet nge-dump memori RAM ke disk. Begitu pagi gua nyalain lagi, database SQLite-nya corrupted. Pendarahan data beneran terjadi. Skrip automation gua bingung mana task yang udah selesai dirender mana yang belom, akhirnya dia ngerender ulang ratusan task yang sama dari awal. Bikin API quota limit gua jebol sia-sia. Pengalaman pahit ini nampar gue keras: Lu bisa nulis kode sebagus apapun, tpi kalo lu ngga ngunci isolasi state data pas mesin dimatiin paksa, failover lu cuma bakal ngehasilin sampah dua kali lipat.

FAQ: Resolusi Krisis Audit Server B2B

Apakah pakai layanan snapshot otomatis dari provider VPS lokal sudah cukup buat Disaster Recovery?

Kagak cukup bos. Snapshot VPS itu emang berguna buat rollback kalo lu salah update sistem operasi (OS). Tapi kelemahannya fatal: file snapshot itu disimpen di rak server atau storage pool yang sama dengan server VPS lu berada. Kalo data center provider lokal lu kebakar atau storage pool mereka corrupt massal, snapshot lu juga ikut hangus. Lu wajib punya offsite backup yang ditarik ke ekosistem cloud dari vendor yang beda total.

Gimana cara ngakalin biaya server Hot Site yang mahal banget padahal jarang dipake?

Kalo budget lu mepet, lu jangan pake Hot Site (server nyala 100%). Lu pake arsitektur Pilot Light atau Warm Site. Intinya lu cuma nyalain database server ukuran kecil di lokasi cadangan buat nangkep sinkronisasi data real-time, tapi server aplikasi web nya lu biarin mati (dormant). Nanti pas server utama lu beneran modar, lu baru trigger skrip otomatis buat nge-scale up server web cadangan lu. Duit lu jauh lebih hemat tapi RTO lu tetep masuk akal di kisaran 15 30 menit.

Apa bener pakai Load Balancer aja udah otomatis bikin server kita kebal dari downtime?

Itu miskonsepsi yang bahaya banget. Load Balancer cuma ngebagi trafik ke beberapa server web (node) yang ada di bawahnya. Kalo satu node mati, node lain bakal nge backup. Tapi pertanyaannya, Load Balancer lu sendiri kan single point of failure! Terus, kalo database lu (yang ada di belakang server web) yang mati, Load Balancer kaga bisa ngapa ngapain. Lu tetep butuh arsitektur High Availability (HA) di level database, bukan cuma di level web server doang.

Bolehkah kita pakai Google Drive atau Dropbox buat nyimpen file backup database SQL perusahaan?

Jangan pernah lakuin ini buat skala enterprise (B2B)! Google Drive atau Dropbox versi standar kaga didesain buat kepatuhan keamanan data tingkat tinggi. Mereka kaga punya fitur Object Lock (Immutable). Kalo akun Google admin lu kena hack, si hacker bisa gampang banget pencet tombol “Delete Forever” dan bersihin trash bin nya. Selalu gunakan enterprise object storage kaya AWS S3, Google Cloud Storage, atau Backblaze B2 yang mensupport S3 API dengan fitur kuncian retensi waktu.