Cara Audit Disaster Recovery: Trik Jitu Anti Gagal Server

Jam dua pagi layar hp lu nyala terang benderang. Panggilan beruntun dari bos besar dan puluhan notifikasi Telegram dari tim NOC (Network Operations Center). Server utama database pelanggan B2B perusahaan lu mati total gara gara panel listrik di data center meledak. Lu yang lagi enak enaknya tidur mendadak mandi keringat dingin. Tapi sedetik kemudian lu senyum tipis, ngerasa aman krena lu inget kemaren sore lu baru aja ngecek log cronjob dan statusnya “Backup Successful”. Lu suruh tim lu buat nge restore data itu ke server cadangan. Tiga jam berlalu, tim lu nelpon balik pake suara getar: “Pak, file backup tar.gz nya korup, ukurannya cuma 12 Kilobyte”. Jantung lu rasanya copot. Omzet miliaran nguap gitu aja. Lu baru aja kena tamparan keras realita: Punya file backup itu kaga sama dengan punya Disaster Recovery Plan.

Ini bukan cerita horor ngarang bebas, bosku. Ini makanan sehari hari gue nanganin perusahaan korporat di Indonesia yang CTO nya pada over PD. Banyak banget eksekutif IT yang kena fatamorgana vendor cloud murah. Mereka kira langganan fitur auto backup seharga lima ratus ribu perak sebulan udah cukup buat nahan kiamat digital. Kalo mental lu masih kaya gini, server lu cuma nunggu giliran buat modar. Artikel ini gue tulis khusus buat lu para pengambil keputusan yang udah muak dikibulin angka angka SLA palsu. Kita bakal autopsi bareng bareng cara audit arsitektur peladen lu sampe ke akar akarnya. Gue bakal kasih lu trik jitu ngebongkar patologi sistem lu sebelum server lu beneran lumpuh dan bikin karir lu tamat.

Definisi Mutlak Parameter Disaster Recovery B2B

Gini ya bos, sbelum kita bedah server lu, kita samain frekuensi dulu pake standar arsitektur keamanan global. Jangan asal pake istilah kalo lu kaga paham fundamentalnya.

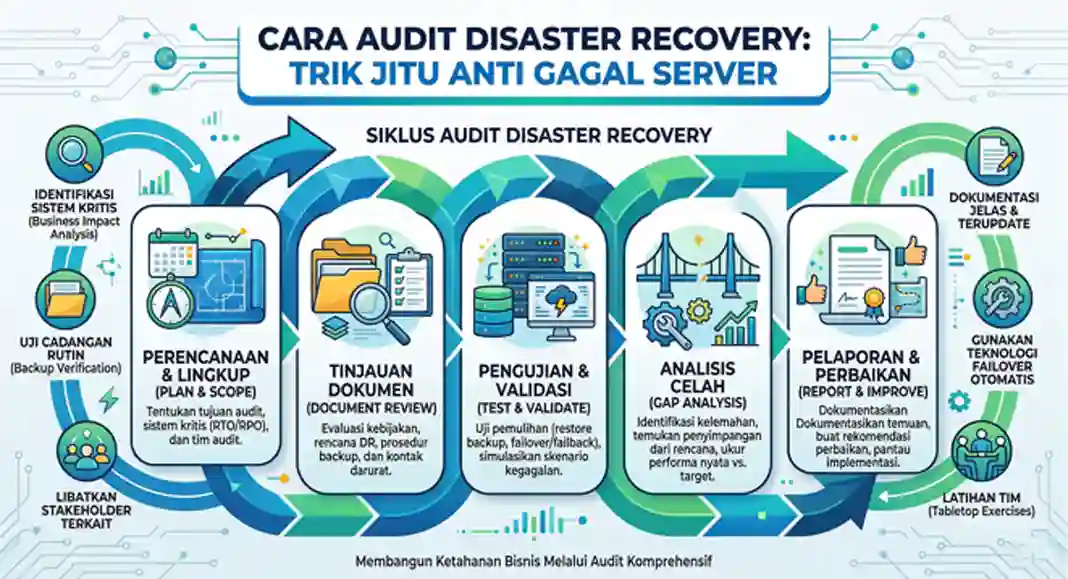

Berdasarkan pedoman Contingency Planning Guide NIST SP 800-34, audit Disaster Recovery adalah proses validasi sistematis terhadap kemampuan infrastruktur IT untuk memulihkan operasi bisnis pasca insiden kritis. Parameter teknis yang dievaluasi mewajibkan:

- Pengukuran deviasi antara target Recovery Time Objective (RTO) dengan durasi pemulihan aktual.

- Validasi integritas data berdasarkan ambang batas Recovery Point Objective (RPO) yang disepakati.

- Eksekusi pengujian failover situs cadangan (Warm/Hot Site) secara berkala.

Tragedi RTO dan RPO yang Bikin Direksi Jantungan

Kesalahan paling tolol yang sering gue liat pas nge audit perusahaan adalah mereka kaga punya angka RTO dan RPO yang tertulis hitam di atas putih. Lu tanya ke manajer IT nya, “Kalo server mati, butuh berapa lama buat nyala lagi?” Jawabannya pasti template: “Secepatnya pak”. Secepatnya itu ukuran tukang ojek, bukan ukuran arsitek jaringan korporat! Lu harus punya metrik yang rigid.

RPO (Recovery Point Objective) itu ngukur seberapa banyak data lu yang boleh ilang. Kalo lu nyetting backup database ritel lu cuma jalan tiap jam 12 malem, dan server lu mati jam 11 siang, berarti transaksi dari jam 12 malem sampe jam 11 siang itu ilang tanpa sisa. Lu ngalamin hemoragi finansial selama 11 jam. Sanggup kaga perusahaan lu nanggung kerugian itu? Kalo kaga sanggup, lu wajib ganti arsitektur lu pake replikasi database real time atau Continuous Data Protection (CDP).

Trus RTO (Recovery Time Objective). Ini argo waktu dari detik server lu mati sampe aplikasi lu bisa dipake lagi buat transaksi. Kalo server lu hancur, dan lu harus pesen server baru, install Ubuntu dari nol, compile Nginx, seting firewall, baru narik data dari cloud storage, itu butuh waktu minimal seharian. Di dunia B2B, downtime 24 jam itu ekuivalen sama sabotase bisnis. Trik jitunya: Lu harus paksa tim lu bikin skrip otomasi pake Ansible atau Terraform. Jadi pas server utama meledak, lu tinggal ketik satu baris perintah di terminal, dan server baru lu kebangun sendiri pake infrastruktur sebagai kode (Infrastructure as Code) dalam hitungan lima menit.

Trik 1: Audit Immutable Backup untuk Menghadang Ransomware

Banyak yang bangga nyimpen backup di NAS (Network Attached Storage) lokal yang ada di dalem kantor. Pas peretas (hacker) ransomware masuk lewat email phising staf finance lu, tau kaga apa yang pertama kali mereka sikat? Yap, file backup lu di NAS itu. Mereka enkripsi semuanya biar lu kaga bisa restore, baru mereka minta tebusan pake Bitcoin. Asimetri serangan kaya gini sering banget manfaatin vakum keamanan jaringan lokal.

Trik jitu pertama buat audit adalah ngecek apakah sistem penyimpanan lu udah pake teknologi Immutable Storage. Ini fitur kelas dewa di layanan object storage (kayak AWS S3 Object Lock). Cara kerjanya simpel tapi mematikan: Data yang udah ditulis ke dalem bucket storage itu kaga bisa dihapus, ditimpa, atau diubah sama siapapun selama rentang waktu tertentu, bahkan sama lu sendiri yang megang password Root! Jadi kalo hacker masuk dan nyoba ngapus file backup lu, sistem AWS bakal nolak mentah mentah perintah itu. Residu data lu tetep aman sentosa. Coba cek sekarang, storage backup lu bisa di delete manual kaga? Kalo bisa, mending lu siap siap aja gigit jari pas diserang.

Trik 2: Bongkar Distorsi Routing BGP dan Failover Jaringan

Server cadangan lu udah nyala, data udah sinkron. Keren. Tapi pertanyaannya, gimana cara pelanggan lu tau kalo mereka harus pindah akses dari IP server Jakarta ke IP server Singapura? Kalo lu masih mikir “tinggal ganti A Record di DNS panel aja pak”, lu ketinggalan jaman sepuluh tahun bosku. Update DNS manual itu butuh waktu propagasi (TTL) yang bisa makan waktu berjam jam. Pelanggan lu keburu kabur pindah ke website kompetitor.

Audit jaringan lu sekarang juga. Lu harus pastiin tim infrastruktur lu pake BGP (Border Gateway Protocol) Anycast atau minimal pake layanan Global Load Balancer. Pas server utama lu batuk batuk kaga ngerespon ping selama tiga detik, sistem monitoring lu harus otomatis mutusin rute trafik dan belokin langsung ke server replika. Ini wajib hukumnya buat ngindarin distorsi akses. Konsep failover brutal kaya gini tuh sebenernya udah sering diterapin di level router lokal juga. Lu bisa baca analitik mendalam gue soal studi kasus konfigurasi failover mikrotik mencegah kebocoran omzet ritel saat koneksi fiber optik utama terputus. Logikanya sama aja, intinya jangan pernah ngandelin intervensi tangan manusia pas lagi krisis. Mesin lu harus bisa nyelametin dirinya sendiri pake skrip detak jantung (heartbeat).

Tabel Komparasi: Arsitektur Basi vs Ekosistem Anti Gagal

Buat lu yang mau presentasi minta budget ke direksi, nih gue kasih contekan tabel perbandingan biar bos lu melek. Jangan ngomong pake bahasa teknis doang, tunjukin perbandingan level risikonya.

| Indikator Ketahanan B2B | Backup Konvensional (Modal Nekat) | Disaster Recovery Enterprise (Level Dewa) |

|---|---|---|

| Waktu Kebangkitan (RTO) | Diatas 12 Jam. Harus setting server fisik/VPS dari nol dan import SQL dump. | Dibawah 5 Menit. Hot Standby server langsung ambil alih trafik via DNS failover otomatis. |

| Kehilangan Data (RPO) | Kehilangan data seharian penuh. Tergantung jadwal cronjob harian. | Nyaris Nol (Zero Data Loss). Memakai replikasi database sinkron/asinkron real-time. |

| Ketahanan Ransomware | Hancur lebur. Backup di drive lokal/mounted disk langsung ikut terkunci. | Sangat Aman. Memakai Immutable S3 bucket yang menolak perintah Delete/Overwrite dari level API. |

| Uji Kelayakan Sistem | Hanya mitos. IT takut nyoba restore krena takut ngerusak server utama. | Chaos Engineering rutin. Isolasi jaringan virtual dipake buat simulasi kiamat tiap tiga bulan. |

Trik 3: Evaluasi Brutal Pake Metode Chaos Engineering

Ini bagian favorit gue. Kalo lu mau tau sistem lu kuat apa kaga, lu harus berani ngehancurin sistem lu sendiri. Jangan nunggu bencana asli dateng. Trik jitu audit yang paling brutal adalah pake metode Chaos Engineering. Lu bikin jadwal hari sabtu subuh, terus lu suruh tim lu sengaja matiin service database MySQL di server utama. Coba liat apa yang terjadi.

Apakah sistem failover lu langsung nendang trafik ke server cadangan? Apakah aplikasi web lu nampilin halaman “Under Maintenance” yang elegan, atau malah nampilin pesan error koding PHP berantakan yang ngebocorin versi framework lu ke publik? Evaluasi gila kaya gini bakal ngebongkar semua titik buta yang selama ini disembunyiin sama vendor lu. Lu bakal kaget nemuin banyak banget skrip yang ternyata nancep mati (hardcoded) ke IP address server lama. Kalo lu kaga pernah ngelakuin simulasi kiamat (DR Drill) minimal dua kali setahun, DRP lu itu cuma kertas sampah yang kaga ada harganya.

Cara Ngomong ke CFO Soal Hemoragi Anggaran

Kendalanya selalu sama ujung ujungnya: Duit. Direktur Keuangan lu pasti bakal ngomel kalo disuruh bayar server kembar (Hot Site) di luar negeri yang 99 persen waktunya cuma diem nganggur nungguin server utama mati. Mereka ngeliat ini sebagai biaya (Cost), bukan investasi. Di sinilah kepakaran lu sebagai psikolog bisnis diuji. Lu harus ubah cara lu ngomong.

Jangan bilang “Pak, kita butuh seratus juta buat server replika”. Ganti kalimat lu jadi gini: “Pak, kemaren pas web kita down 4 jam, kita kehilangan potensi transaksi B2B senilai tiga ratus juta. Kalo kita biarin pake arsitektur sekarang, bulan depan pas server storage kita jebol, kita bakal butuh waktu dua hari buat benerin. Bapak siap neken kerugian omzet dua miliar plus denda SLA dari klien korporat kita?”

Lu harus tampar mereka pake kalkulasi Cost of Downtime. Kasi liat hitung hitungan hilangnya produktivitas karyawan, denda keterlambatan, sampe hancurnya reputasi perusahaan. Tunjukin juga pedoman standar dari NIST Contingency Planning Guide sebagai bukti otoritatif bahwa perusahaan lu menyimpang dari standar kepatuhan (compliance) internasional. Kalo lu udah ngomong pake bahasa risiko dan hukum, budget ratusan juta buat Disaster Recovery bakal cair dalam sekejap. Ini bukan soal beli server, ini soal beli ketenangan batin buat jajaran direksi.

Kesadaran Penuh Mengamankan Ekuitas Digital

Audit Disaster Recovery bukan sekadar tugas checklist tahunan buat menuhin syarat ISO 27001. Ini adalah urat nadi bisnis B2B lu. Membiarkan perusahaan lu berjalan tanpa arsitektur pemulihan yang rigid sama aja kaya lu nyetir mobil sport di jalan tol tapi kaga pake sabuk pengaman dan remnya blong.

Pulang dari baca artikel ini, panggil manajer IT lu. Minta mereka tunjukin log pemulihan (restore log) dari bulan kemaren. Minta mereka demonstrasi live mutusin koneksi server pake Chaos Engineering. Kalo mereka kaga berani atau banyak alasan, lu udah tau jawabannya. Bersihin sistem lu sekarang. Hancurkan fatamorgana keamanan itu, pindahin backup lu ke immutable storage, bangun rute failover otomatis, dan pastiin lu bisa tidur nyenyak malem ini tanpa takut kiamat server ngetuk pintu rumah lu jam dua pagi.

FAQ: Resolusi Krisis Audit Server B2B

Apakah pakai layanan snapshot otomatis dari provider VPS lokal sudah cukup buat Disaster Recovery?

Kagak cukup bos. Snapshot VPS itu emang berguna buat rollback kalo lu salah update sistem operasi (OS). Tapi kelemahannya fatal: file snapshot itu disimpen di rak server atau storage pool yang sama dengan server VPS lu berada. Kalo data center provider lokal lu kebakar atau storage pool mereka corrupt massal, snapshot lu juga ikut hangus. Lu wajib punya offsite backup yang ditarik ke ekosistem cloud dari vendor yang beda total.

Gimana cara ngakalin biaya server Hot Site yang mahal banget padahal jarang dipake?

Kalo budget lu mepet, lu jangan pake Hot Site (server nyala 100%). Lu pake arsitektur Pilot Light atau Warm Site. Intinya lu cuma nyalain database server ukuran kecil di lokasi cadangan buat nangkep sinkronisasi data real-time, tapi server aplikasi web nya lu biarin mati (dormant). Nanti pas server utama lu beneran modar, lu baru trigger skrip otomatis buat nge-scale up server web cadangan lu. Duit lu jauh lebih hemat tapi RTO lu tetep masuk akal di kisaran 15 30 menit.

Apa bener pakai Load Balancer aja udah otomatis bikin server kita kebal dari downtime?

Itu miskonsepsi yang bahaya banget. Load Balancer cuma ngebagi trafik ke beberapa server web (node) yang ada di bawahnya. Kalo satu node mati, node lain bakal nge backup. Tapi pertanyaannya, Load Balancer lu sendiri kan single point of failure! Terus, kalo database lu (yang ada di belakang server web) yang mati, Load Balancer kaga bisa ngapa ngapain. Lu tetep butuh arsitektur High Availability (HA) di level database, bukan cuma di level web server doang.

Bolehkah kita pakai Google Drive atau Dropbox buat nyimpen file backup database SQL perusahaan?

Jangan pernah lakuin ini buat skala enterprise (B2B)! Google Drive atau Dropbox versi standar kaga didesain buat kepatuhan keamanan data tingkat tinggi. Mereka kaga punya fitur Object Lock (Immutable). Kalo akun Google admin lu kena hack, si hacker bisa gampang banget pencet tombol “Delete Forever” dan bersihin trash bin nya. Selalu gunakan enterprise object storage kaya AWS S3, Google Cloud Storage, atau Backblaze B2 yang mensupport S3 API dengan fitur kuncian retensi waktu.